11月6日,云九资本投资的AI科技公司「Kimi AI」正式发布并开源Kimi K2 Thinking。据称,这是Kimi迄今能力最强的开源思考模型。

Kimi K2 Thinking是Kimi基于「模型即 Agent」理念训练的新一代Thinking Agent,它原生掌握「边思考,边使用工具」的能力。在人类最后的考试(Humanity’s Last Exam)、自主网络浏览能力(BrowseComp)、复杂信息收集推理(SEAL-0)等多项基准测试中表现达到SOTA水平,并在Agentic搜索、Agentic编程、写作和综合推理能力等方面取得全面提升。

Kimi K2 Thinking模型无需人类干预,即可自主实现高达 300 轮的工具调用和持续稳定的多轮思考能力,从而帮助用户解决更复杂的问题。这是Kimi在Test-Time Scaling(测试时扩展)领域的最新进展,通过同时扩展思考Token和工具调用的轮次,实现更强的 Agent 和推理性能。

Kimi K2 Thinking模型已上线 kimi.com 和最新版Kimi手机应用的常规对话模式。Kimi Agent模式的底层模型后续也将升级为Kimi K2 Thinking模型,带来完整的多轮思考和工具调用能力。

Kimi K2 Thinking模型的API可通过 Kimi 开放平台(platform.moonshot.cn)访问。如需自行部署,开发者亦可在Hugging Face、ModelScope 等平台下载模型。

推理性能全面提升

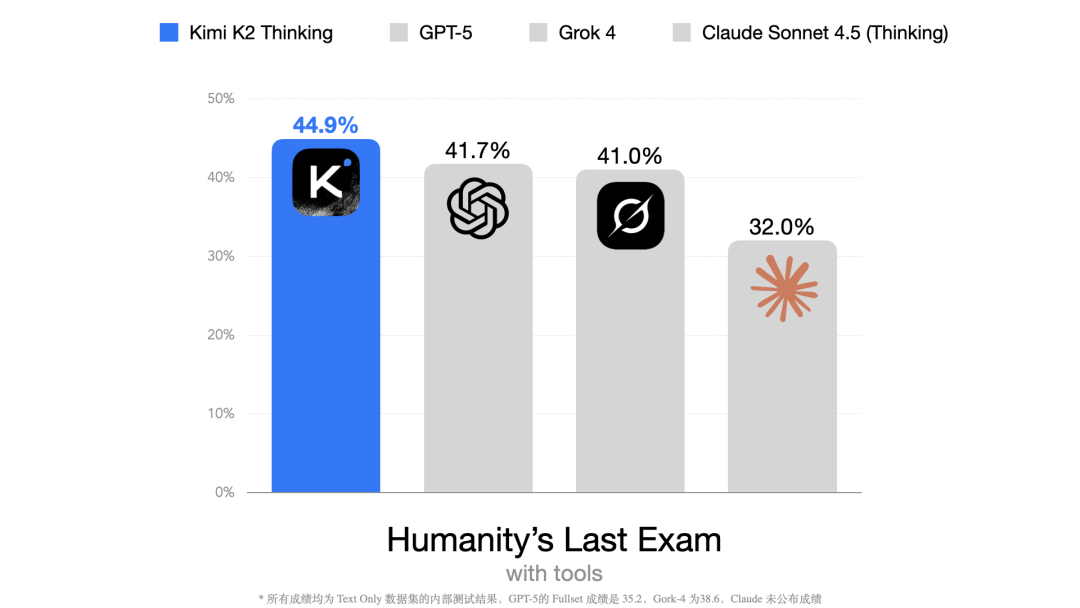

Kimi K2 Thinking 模型在“人类最后的考试(Humanity’s Last Exam)”中展现出强大的推理与问题解决能力。人类最后的考试是一项涵盖 100 多个专业领域的终极封闭式学术测试。在允许使用工具——搜索、Python、网络浏览工具的同等情况下,Kimi K2 Thinking 在这项基准评测中取得了 44.9% 的 SOTA 成绩。

自主搜索与浏览能力全面提升

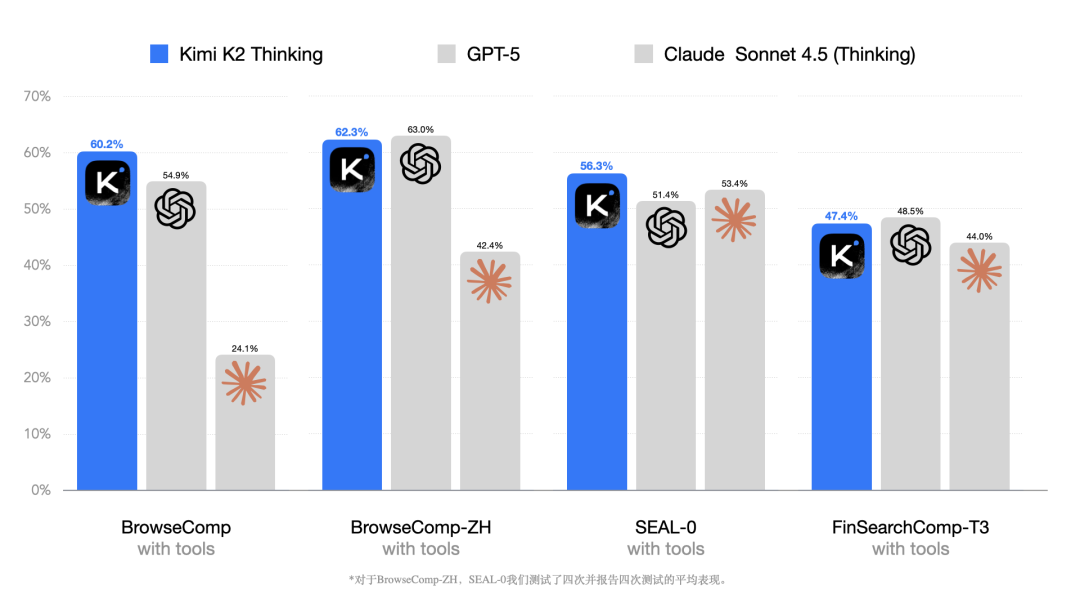

在复杂搜索和浏览场景中,Kimi K2 Thinking模型也表现出色。BrowseComp是由OpenAI发布的一个专门评估AI Agent网络浏览能力的基准测试,这项测试的初衷是衡量AI Agent在信息过载环境中展现出的坚持性与创造力,即能否像人类研究员一样「刨根问底」。在这项极具挑战的任务上,人类平均只能达到 29.2% 的成绩。Kimi K2 Thinking在这项基准测试中展现出极强的钻研能力,以 60.2% 的成绩成为新的 SOTA 模型。

在长程规划和自主搜索能力的驱动下,Kimi K2 Thinking 可借助多达上百轮的“思考 → 搜索→ 浏览网页 → 思考 → 编程”动态循环,持续地提出并完善假设、验证证据、进行推理,并构建出逻辑一致的答案。这种边主动搜索边持续思考的能力,使 Kimi K2 Thinking 能够将模糊且开放式的问题分解为清晰、可执行的子任务。

Agentic 编程能力持续精进

Kimi K2 Thinking 模型的编码能力也得到了增强,在多语言软件工程基准 SWE-Multilingual、SWE-bench 验证集和 Terminal 终端使用等基准测试中的表现有了进一步提升。

据观察,Kimi K2 Thinking 在处理 HTML、React 以及组件丰富的前端任务时性能有明显提升,能将创意转变为功能齐全、响应式的产品。在 Agentic Coding 场景中,Kimi K2 Thinking 能在调用各种工具的同时进行思考,灵活地融入 software agents 中,处理更复杂、多步骤的开发工作流。

通用基础能力升级

创意写作:Kimi K2 Thinking显著提升了写作能力,它能将粗略的灵感转化为清晰、动人且意图明确的叙述,使其兼具韵律感和深度。它能轻松驾驭微妙的文风差异和模糊的结构,并在长篇大论中保持风格的连贯性。在创意写作方面,它笔下的意象更生动,情感共鸣更强烈,将精准的表达与丰富的表现力融为一体。

学术与研究:在学术研究和专业领域,Kimi K2 Thinking在分析深度、信息准确性和逻辑结构方面均有显著提升。它能有条不紊地剖析复杂的指令,并以清晰严谨的方式拓展思路。这使其尤其擅长处理学术论文、技术摘要,以及那些对信息完整性和推理质量要求极高的长篇报告。

个人与情感:在回应个人或情感类问题时,Kimi K2 Thinkin

g的回答更富同理心,立场也更中正平和。它的思考深入周到且具体明确,能提供细致入微的观点和切实可行的后续建议。它能清晰并关切地帮助用户梳理复杂的决策,其语气既脚踏实地又切实中肯,更有人情味。

原生 INT4 量化提升推理效率低比特量化是降低大规模推理服务器的延迟和 GPU 显存占用的有效方法。测试发现,因为思考模型会产生极长的解码长度,常规的量化手段往往会导致模型性能大幅下降。为了克服这一挑战,Kimi在后训练(post-training)阶段采用了量化感知训练(QAT),并对MoE组件应用了 INT4 纯权重(weight-only)量化。

这使得 Kimi K2 Thinking 模型能够在复杂推理和 Agentic 任务中支持原生的 INT4 推理,并将生成速度提升了约 2 倍。INT4 对推理硬件的兼容性更强,对国产加速计算芯片也更加友好。值得注意的是, Kimi K2 Thinking 模型所有的基准测试成绩都是在 INT4 精度下取得的。